Tekst ukazał się w „Filozofuj!” 2018 nr 6 (24), s. 16–17. W pełnej wersji graficznej jest dostępny w pliku PDF.

Ludzki umysł to też tylko maszyna

Cokolwiek może zrodzić się w myślach organizmu żywego, może też być w umyśle sztucznym, jeśli tylko współczesne teorie biologiczne weźmiemy poważnie. Przecież inteligentne zwierzęta, w tym i ludzie, okazują się jedynie myślącymi maszynami. Osiągnięcia nauki pozwalają powiedzieć wprost: to, co kiedyś uważano za szalone myśli radykała, takiego jak Julien Offray de la Mettrie (1709–1751), budzącego zgorszenie książkami Człowiek-maszyna, a wcześniej Człowiek-roślina, dziś wydaje się banałem. Tak, mechanizmy biologiczne są tylko mechanizmami. Nie ma siły życiowej, tajemniczego tchnienia, które odróżniałoby bakterie od wirusów. Różni je tylko możliwość realizacji procesów przemiany materii, wsparta na zdolności do samoorganizacji, ograniczonej i ułomnej, bo jednak niemogącej stawić czoła nieuniknionej śmierci i przemijaniu.

Tak, myślących maszyn należy się bać, tak jak należy bać się ludzkiej lekkomyślności, głupoty i skłonności do rozwiązywania problemów przemocą. Jednak nie trzeba się bać przesadnie. Wielokroć bardziej szkodliwy jest złośliwy polityk o dużej władzy, odrzucający ustalenia nauki w imię swojego, wąsko pojętego interesu, od najbardziej inteligentnego komputera, który jedynie przetwarza informacje bez wpływu na rzeczywistość. Lęk, że samo szybkie rozwiązywanie problemów da sztucznej inteligencji ogromną władzę, jest mało uzasadniony.

Chociaż kasandryczne wizje o sztucznej inteligencji przejmującej władzę snuli nawet tak wybitni naukowcy jak Stephen Hawking, traktowałbym je z przymrużeniem oka. A to dlatego, że nawet gdyby nastąpił mało prawdopodobny gwałtowny przełom w budowaniu maszyn inteligentnych, to mogą one okazać się równie pozbawione wpływu na rzeczywistość ekonomiczną czy polityczną, jak miliardy ludzi, nie mówiąc o miliardach inteligentnych zwierząt. Żeby inteligencja stała się groźna, musiałaby sięgnąć po władzę.

Po co sztucznej inteligencji władza?

Tymczasem nieszczególnie wiemy, jak – i po co – budować maszyny mające elementarne emocje. Bez emocji zaś sztuczna inteligencja raczej nie będzie pragnąć władzy. Co najwyżej będzie realizować jakiś algorytm, który oczywiście może być nowy i twórczy. Dzisiaj trudno nam powiedzieć, w jaki sposób maszyny w ogóle mogłyby sobie wyznaczać cele. Obecny rozwój systemów sztucznej inteligencji jest, co prawda, burzliwy, ale nie jest równomierny. Koncentruje się głównie na możliwościach wydobywania abstrakcyjnych wzorców z istniejących danych – czyli na uczeniu maszynowym. Myślenie na temat siebie samego i zdobywanie zasobów w celu dalszego istnienia pozostaje na razie poza horyzontem współczesnych systemów.

Specjalnie podkreślam, że chodzi o systemy współczesne. Jest z pewnością możliwe technicznie, że wyposażone w sztuczną inteligencję systemy mogłyby zyskać coś w rodzaju samodzielności układów biologicznych – istoty żywe to przecież też maszyny szczególnego typu. Lecz nawet gdyby ją miały, nie jest jasne, w jaki sposób miałyby zdobyć władzę polityczną.

Od inteligencji do inżynierii społecznej

Oczywiście wiemy, że w epoce internetu bezpieczeństwo społeczeństw ludzkich zależy od istnienia zabezpieczeń przed atakami informatycznymi. Niezdolne do nudy systemy sztucznej inteligencji stanowią spore zagrożenie, gdyż mogą żmudnie i coraz bardziej kreatywnie próbować takie zabezpieczenia omijać. Do tej pory najwyższym zagrożeniem zabezpieczeń w internecie pozostaje tzw. czynnik ludzki – hakerzy bowiem potrafią po prostu zadzwonić do osoby odpowiedzialnej za zabezpieczenia i podszyć się pod osobę, która jest uprawniona do ich wyłączenia. Na razie systemy sztucznej inteligencji są kompletnie niezdolne do tak wyrafinowanej inżynierii społecznej.

Taka inżynieria wymaga bowiem przynajmniej minimalnej umiejętności przewidywania i wyjaśniania tego, co myślą inni. Jednak nadal nie wiemy, co jest potrzebne, żeby mieć skuteczny model tego, co myślą inni. Między innymi dlatego zbudowanie prawdziwej sztucznej inteligencji, takiej, która zdołałaby zawsze podszyć się pod człowieka, przynajmniej w rozmowie, jest tak piekielnie trudne. I chociaż Alan Turing, genialny matematyk i filozof, już prawie 70 lat temu proponował, by sztuczną inteligencję – a więc i sztuczne myślenie w ogóle – oceniać po owocach, które powinny być nieodróżnialne od ludzkich, to jego test pozostaje cały czas trudnym wyzwaniem. Polega on na tym, że system sztucznej inteligencji ma prowadzić nieograniczoną tematycznie i czasowo rozmowę, nie będąc rozpoznanym jako taki, lecz będąc uznanym za człowieka. Tymczasem nawet nie wiemy, jak do realnego przejścia tego testu nawet miałoby dojść.

Czy bać się sztucznej inteligencji?

Wiemy, że kiedyś do tego dojdzie. Lecz założenie, że kiedy tylko maszyny uzyskają możliwość szybszego wydobywania abstrakcyjnych wzorców, natychmiast zyskają możliwość przejścia testu Turinga, wyznaczą sobie złowieszcze dla ludzkości cele i przejmą władzę nad światem, jest po prostu naiwne. Nie od razu Rzym zbudowano. Dlatego wiara, że istnieje magiczny punkt – zwany w literaturze „osobliwością” – po którego przekroczeniu sztuczna inteligencja zacznie rozwijać się tak żywiołowo, aż błyskawicznie przekroczy ludzką, wydaje się raczej typowym błędem w rozumowaniu: to równia pochyła. Nie ma żadnej gwarancji, że inteligencja sama siebie zacznie napędzać i przyspieszać. Dojść do tego może, ale zapewne do tego czasu ludzkość będzie się raczej zmagać z problemem związanym z tym, jak potraktowała swoje środowisko naturalne, doprowadzając do globalnego ocieplenia. Ta katastrofa jest znacznie bardziej realna – i mogłaby zostać powstrzymana, gdyby nie egoizm największych krajów i korporacji globalnych.

Marcin Miłkowski – profesor w Instytucie Filozofii i Socjologii Polskiej Akademii Nauk, w Zakładzie Logiki i Kognitywistyki, filozof nauk o poznaniu. W wolnych chwilach programuje, słucha jazzu i jeździ na rowerze.

Marcin Miłkowski – profesor w Instytucie Filozofii i Socjologii Polskiej Akademii Nauk, w Zakładzie Logiki i Kognitywistyki, filozof nauk o poznaniu. W wolnych chwilach programuje, słucha jazzu i jeździ na rowerze.

Tekst jest dostępny na licencji: Uznanie autorstwa-Na tych samych warunkach 3.0 Polska.

< Powrót do spisu treści numeru.

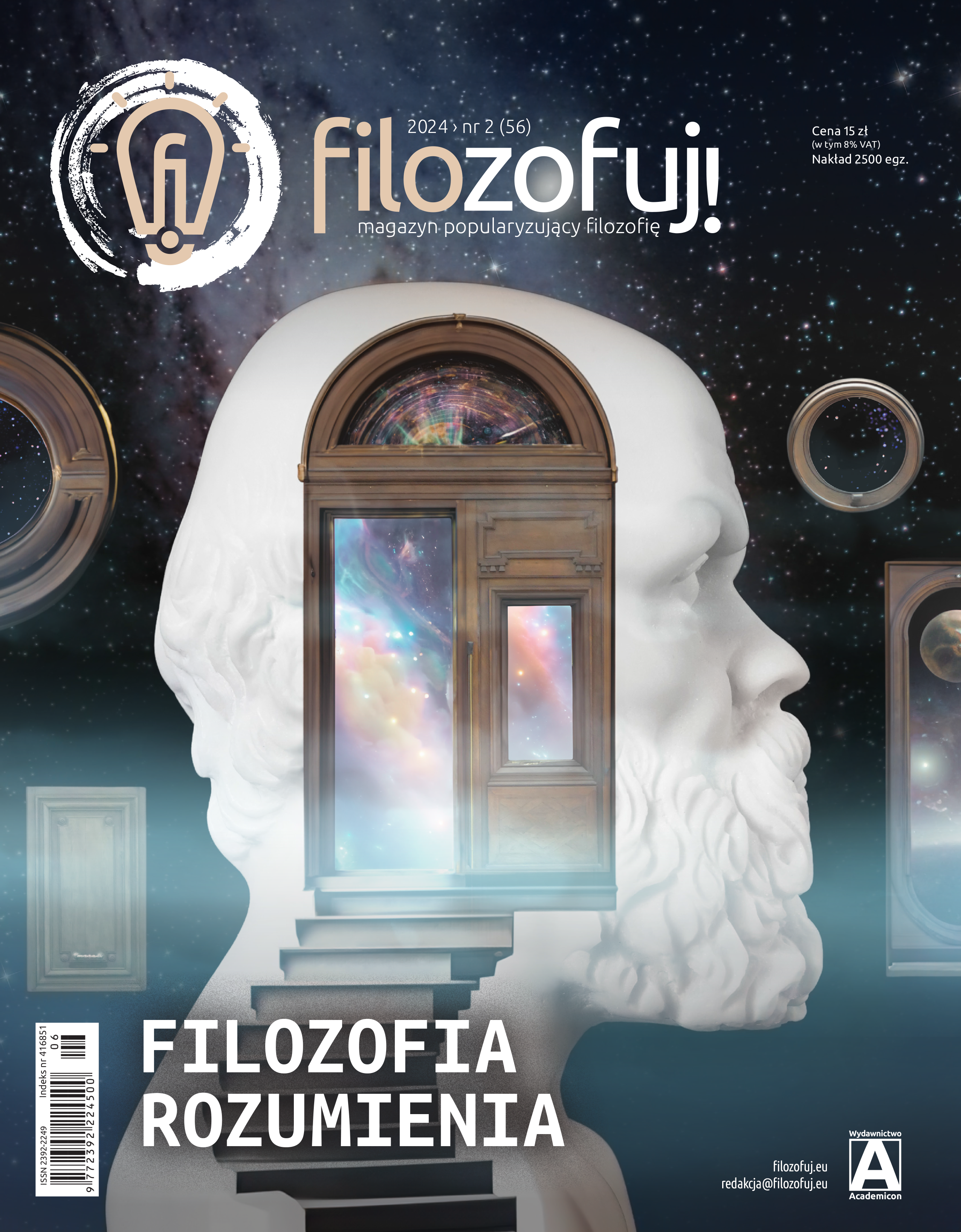

Ilustracja: Małgorzata Uglik

Skomentuj